自从Bert网络模型产数量超过3亿规模,当时候只是觉得性能好,没想到GPT系列出来后,GPT-3直接用170B规模的参数量模型精度碾压竞品。 接着就是新一轮的竞争了,后面的事情就有点可怕了,Google推出万亿稀疏switch transformer,huawei推出2000亿稠密鹏程盘古大模型,微软推出Turing-NLG有1000亿参数,英伟达推出MegatronLM系列。 大家都说大模型难,大模型训练除了集群调度麻烦,还难在哪里吗?

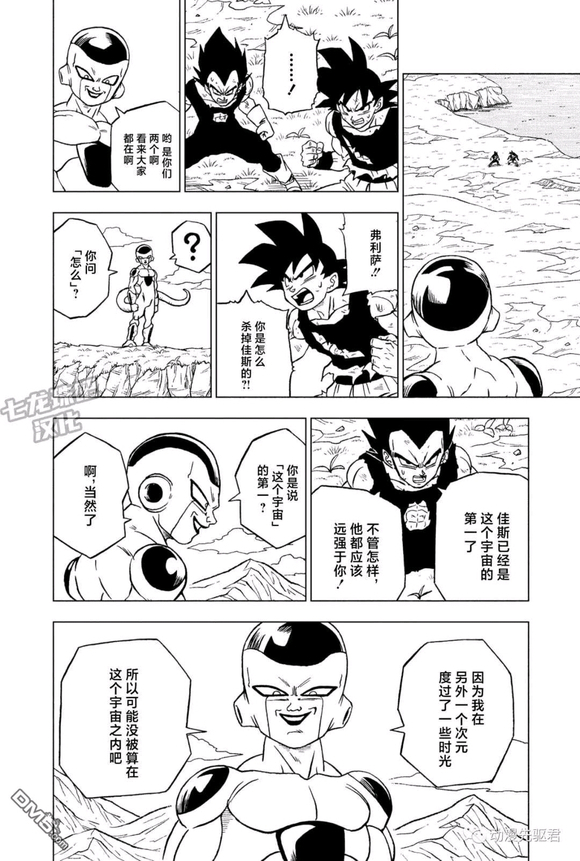

【壁次元】,建站于2023年1月1日, 是一家动漫图片与图包下载网站,在这里绝大多数的动漫图片都可以搜索到。

关于

友情链接

商业友情链接

加入Q群961162565

© 2019-2022 壁次元 备案号:黔ICP备2021005401号